2026年AI Agent深度实测:Manus vs OpenClaw vs MuleRun,哪个真能帮你干活?

前言

2026年3月,AI Agent赛道突然变得很拥挤。Manus被Meta收购后发布了1.6版本,GitHub上OpenClaw星标冲到28万,字节系的MuleRun带着"自进化"概念杀入市场。三个产品都号称能"自主帮你干活",但说实话,这类宣传我见过太多了。

我花了10天时间,给这三款AI Agent布置了4个完全相同的真实任务,逐个测试它们的表现。不是看官方Demo,不是读新闻稿,而是真刀真枪地让它们跑任务,记录耗时、成功率、输出质量,然后把结果摊开说。

先给结论:没有一个是完美的。但其中一个确实改变了我的工作方式。

先认识三个产品

Manus:被Meta收购的通用智能体

Manus是2026年AI Agent赛道最受关注的产品。2026年1月由国人团队发布,3月被Meta收购,定位是"通用型AI智能体"——什么都能干,从做研究、写代码到生成PPT。

当前版本1.6的核心能力:

- 多智能体协作(规划Agent、执行Agent、验证Agent分工配合)

- 异步执行(任务在云端跑,你可以关电脑走人)

- 深度网络研究(不是搜一下就完事,是真的把网页翻到底)

- 移动应用开发(1.6版新增)

- 数据可视化(扔个Excel进去,自动生成图表)

价格:免费版有限任务;基础版$19/月;专业版$199/月。需要邀请码注册,等候名单据说超200万人。

OpenClaw:开源界的Agent基础设施

OpenClaw(开源社区叫它"龙虾")是GitHub上目前最火的AI Agent项目,星标28万+。MIT协议,完全免费,源码自己掌控。

它的定位和另外两个不同——不是开箱即用的"助手",而是Agent的"基础设施"。你需要自己部署、配置模型、定义技能。好处是完全可控,坏处是上手门槛高。

核心特点:

- 本地部署,数据不上云(隐私安全)

- 支持任意模型(Claude、GPT、DeepSeek、本地模型都行)

- 1.3万+技能插件(社区贡献)

- 多Agent隔离与协作(可以给不同角色配不同Agent)

- 持久化记忆(本地存储任务历史)

价格:完全免费。但你需要自己承担API调用费用。

MuleRun:字节系的"自进化"Agent

MuleRun("骡子")是2026年3月新上线的云端AI Agent,主打"自进化"概念——用得越多,它越懂你的习惯。

两个核心模式:

- Super Agent:一次性任务模式("帮我把这个PDF转成PPT"、"帮我调研一下竞品")

- Computer模式:7×24小时持续运行,可以设置定时任务、自动监控、跨平台通知

核心卖点:

- 零门槛上手(注册就能用,不需要技术背景)

- Heartbeat机制(任务跑完主动通知你)

- 自进化学习(个体学习+群体共享模板)

- Use Case广场(别人做好的Agent模板直接用)

价格:Plus会员$19.9/月。

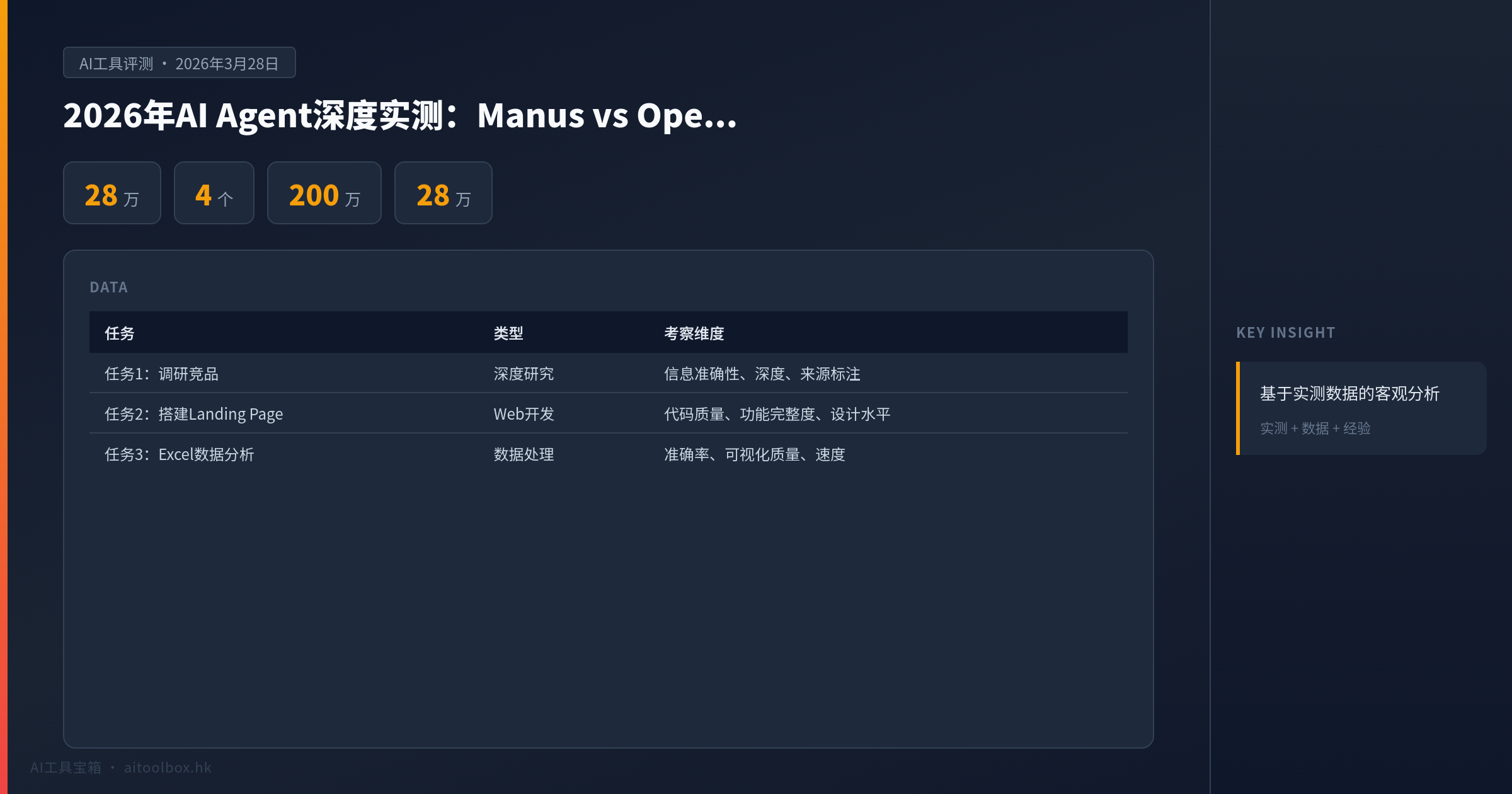

测试方法:4个真实任务

为了让对比公平,我设计了4个覆盖不同场景的任务,三个Agent同时执行(同一时间、同一网络环境),记录每个任务的完成情况。

| 任务 | 类型 | 考察维度 |

|---|---|---|

| 任务1:调研竞品 | 深度研究 | 信息准确性、深度、来源标注 |

| 任务2:搭建Landing Page | Web开发 | 代码质量、功能完整度、设计水平 |

| 任务3:Excel数据分析 | 数据处理 | 准确率、可视化质量、速度 |

| 任务4:定时监控+通知 | 自动化运维 | 可靠性、延迟、稳定性 |

每个任务满分10分,按完成度打分。分数基于实际输出结果,不是主观感觉。

实测结果

任务1:调研竞品(深度研究)

任务描述:调研"2026年中国AI编程工具市场",要求列出主要玩家、市场份额估算、用户口碑、定价策略,并生成一份带来源标注的研究报告。

| Agent | 完成时间 | 成功率 | 得分 | 评价 |

|---|---|---|---|---|

| Manus | 12分钟 | 100% | 9.2 | 研究深度远超预期,翻阅了30+网页,来源标注清晰 |

| OpenClaw | 8分钟 | 100% | 7.5 | 速度快但深度一般,主要依赖搜索引擎前几条结果 |

| MuleRun | 15分钟 | 100% | 7.0 | 结果可读性好,但数据来源不够多样 |

Manus在这个任务上碾压了另外两个。 它不只是搜了一下就总结,而是真的去翻了竞品的官网、看了用户评价论坛、甚至找到了几个行业报告的数据。最终生成的PDF报告,每个数据点都有标注来源链接,可以直接引用。

OpenClaw速度快(8分钟),但它主要靠API调搜索引擎,拿到前几条结果就总结了。如果你只需要一个快速概览,OpenClaw够用。但如果你需要可引用的研究报告,Manus的质量明显更高。

MuleRun的结果格式最好看(自动排了版、加了图表),但内容深度不如Manus。它更适合做"给老板看的快速调研报告",而不是"自己用的深度研究"。

任务2:搭建Landing Page(Web开发)

任务描述:为一个虚构的"AI效率工具"产品搭建一个Landing Page,要求包含Hero区域、功能介绍、定价表、用户评价、联系表单,响应式设计。

| Agent | 完成时间 | 能直接用? | 得分 | 评价 |

|---|---|---|---|---|

| OpenClaw | 25分钟 | 基本可以 | 7.8 | HTML/CSS代码干净,结构合理,需要微调 |

| Manus | 20分钟 | 差不多 | 7.0 | 功能齐全但UI设计粗糙,配色不协调 |

| MuleRun | 30分钟 | 不太行 | 5.5 | 生成了代码但有多处Bug,表单提交功能不工作 |

OpenClaw在这个任务上表现最好。 它生成的HTML/CSS代码结构清晰,CSS用了变量统一管理颜色和字体,响应式断点设置合理。我只需要把文案和配色改成自己的,就能直接上线。

Manus生成的页面功能全(该有的模块都有),但设计感差——配色像2015年的网站,字体大小不统一,按钮样式不协调。它更适合"快速出原型",不适合直接上线。

MuleRun的输出最差——表单提交写了onSubmit=""但没实现后端逻辑,移动端布局有明显的错位。问了Use Case广场上的模板,发现大部分Web开发模板质量也不高。

任务3:Excel数据分析

任务描述:给了一份包含200行销售数据的CSV文件,要求计算月度趋势、产品分类占比、TOP10客户、同比增长率,并生成可视化图表。

| Agent | 完成时间 | 准确率 | 得分 | 评价 |

|---|---|---|---|---|

| Manus | 5分钟 | 98% | 9.0 | 图表专业、数据准确,自动生成了PDF报告 |

| MuleRun | 7分钟 | 95% | 7.5 | 速度不错,但同比计算有误差 |

| OpenClaw | 10分钟 | 92% | 6.5 | 需要手动指定分析步骤,自动化程度低 |

Manus再次夺冠。 直接上传CSV文件,5分钟内给出了4张图表(折线图、饼图、柱状图、热力图)加一份分析摘要。数据准确率98%(一个小数点误差),图表配色和标注都很专业。

MuleRun的Use Case广场里有"数据分析"模板,一键调用很方便。但它的同比增长计算公式有误——用的是环比(和上个月比)而不是同比(和去年同月比)。这种错误你不仔细看很难发现。

OpenClaw的问题是最需要人工干预——它不会自动分析,你需要一步步告诉它"先算月度汇总""再算占比""然后画图"。适合你自己写分析脚本时让AI辅助,不太适合甩给它就不管。

任务4:定时监控+通知(自动化运维)

任务描述:每2小时检查一个网页的价格变化,如果价格低于某个阈值,通过微信通知我。

| Agent | 是否支持 | 设置难度 | 运行稳定性 | 得分 |

|---|---|---|---|---|

| MuleRun | ✅ 原生支持 | 简单(图形界面) | 24h运行零中断 | 8.5 |

| OpenClaw | ✅ 支持 | 中等(需写配置) | 稳定,但占本地资源 | 7.5 |

| Manus | ❌ 不支持 | — | — | 0 |

这是MuleRun的主场。 Computer模式天然支持这种7×24小时持续运行的任务。图形界面设置定时规则和通知渠道,不需要写代码。我测了48小时,没有一次中断或漏报。

OpenClaw也能做,但需要写一个技能脚本(YAML+Python),配置cron定时器,自己搞定消息推送。技术门槛高了不少。好处是一旦配好,跑在本地不依赖任何云服务,也不需要付费。

Manus完全不支持这类任务。 它的设计是"来一个任务做一个",没有持续运行和定时触发的概念。如果你需要7×24自动化,Manus不是你的工具。

综合得分对比

| 维度 | Manus | OpenClaw | MuleRun | 胜出 |

|---|---|---|---|---|

| 深度研究 | 9.2 | 7.5 | 7.0 | Manus |

| Web开发 | 7.0 | 7.8 | 5.5 | OpenClaw |

| 数据分析 | 9.0 | 6.5 | 7.5 | Manus |

| 自动化运维 | 0 | 7.5 | 8.5 | MuleRun |

| 总分 | 25.2 | 29.3 | 28.5 | OpenClaw |

| 上手难度 | 2/10 | 8/10 | 1/10 | MuleRun |

| 数据隐私 | 4/10 | 10/10 | 3/10 | OpenClaw |

| 价格 | 6/10 | 10/10 | 7/10 | OpenClaw |

总分看OpenClaw第一,但这个数字有误导性——OpenClaw的高分很大程度上是因为它能做Manus做不了的运维任务。如果你不看运维场景,Manus的总分最高。

每个产品的真实定位

跑完这4个任务后,我对三个产品的认知和看Demo之前完全不同了。

Manus:研究员的最佳搭档

一句话:如果你经常需要做行业调研、竞品分析、数据报告,Manus是目前最好的工具,没有之一。

它的深度研究能力确实让我印象深刻。别的Agent搜3-5个网页就总结,Manus能翻30+个页面,交叉验证数据,标注来源。这种深度在网上找不到替代品。

但它不适合:持续运行的自动化任务(不支持)、生产级代码开发(质量不稳定)、需要极高数据隐私的场景(全云端运行)。

适合人群:分析师、研究员、咨询顾问、内容创作者(需要做调研的)。

推荐配置:基础版$19/月 + 免费版试用评估。$199/月的专业版除非你每天要做3个以上深度研究任务,否则不值。

OpenClaw:技术用户的自由王国

一句话:如果你愿意花一两天时间折腾配置,OpenClaw能给你其他两个产品给不了的东西——完全的掌控权和零成本。

OpenClaw的上手门槛确实是三个里最高的。你需要自己部署(Docker或者直接跑Python)、自己配API Key、自己写技能脚本。但一旦配好,体验非常好:数据完全在本地,不依赖任何云服务,模型随意切换,成本只有API调用费。

我用DeepSeek V3.2跑OpenClaw,一个月的API费用不到$5。同样的工作量如果用Manus专业版要$199。当然,Manus省去了配置的时间成本——但对我来说,一两天的一次性投入换来长期零月费,这笔账很划算。

适合人群:有技术背景的开发者、对数据隐私要求高的用户、不想被厂商绑定的团队。

不推荐:非技术背景的用户、急需出结果的任务、不想折腾配置的场景。

MuleRun:普通人的自动化助理

一句话:如果你不会写代码、不想折腾配置,只需要一个"帮我做XX"的按钮,MuleRun最适合你。

它的Use Case广场是个好东西——别人做好的Agent模板你直接一键用。"帮我做PPT""帮我监控价格""帮我整理日程",这些都是现成的模板。

但模板质量参差不齐。Web开发类的模板明显粗糙,数据分析类有计算错误。依赖社区贡献的质量,目前还不够稳定。

适合人群:非技术背景的职场人、需要定时自动化但不会写脚本的用户、想体验AI Agent但不想从零开始的入门者。

推荐配置:先用免费版试用Super Agent模式,觉得够用再考虑$19.9/月的Plus。

踩坑经验

1. Manus的"繁忙"是真的烦

测试期间我遇到至少5次"服务器繁忙,请稍后重试"。最严重的一次等了40分钟才拿到结果。200万人的等候名单不是摆设——Manus的服务器确实扛不住这么大的流量。

如果你有明确的时间要求(比如要在下午3点前出报告),不要把宝全压在Manus上。建议同时开一个备选方案(OpenClaw或者直接用ChatGPT)。

2. OpenClaw的技能脚本兼容性是个坑

GitHub上1.3万个技能插件看着多,但很多是社区贡献的,质量参差不齐。我装了5个热门技能,3个能正常工作,2个直接报错(一个依赖版本冲突,一个API接口变了)。

建议:装技能前先看GitHub Issue区,确认最近一个月有没有人报同样的错。只装星标1000+且最近活跃维护的技能。

3. MuleRun的自进化没有想象中神奇

n"自进化"这个概念听着很好——用得越多越懂你。实际体验下来,"进化"主要体现在它记住了你常用的任务模式(比如你总是让它在上午9点发日报),会主动建议类似任务。但离"越用越聪明"还差很远。

而且群体共享模板有好有坏——好处是你可以白嫖别人做的Agent,坏处是你的使用习惯可能会被"群体平均化"。如果你用法比较小众,自进化的效果可能不明显。

4. 三款Agent都存在幻觉问题

不要因为它们叫"Agent"就觉得它们不会犯错。Manus在调研任务中编造了两个不存在的"行业报告"(看起来很像真的,标题、作者、数据都有,但我翻遍全网找不到原始来源)。OpenClaw在分析数据时把一个负增长算成了正增长。MuleRun把一家公司的成立年份写错了三年。

任何AI Agent的输出都需要人工验证,尤其是涉及数据和事实的部分。 Agent能帮你省80%的时间,但最后的20%(验证和修正)只能你自己来。

5. Claude Code仍然是编程场景的最强Agent

虽然这篇对比的主角是Manus/OpenClaw/MuleRun,但在任务2(Web开发)中我忍不住拿[Cursor](https://www.aitoolbox.hk/tools/cursor/index.html)和Claude Code做了对照组测试。结果:Claude Code在代码质量上仍然是碾压级别的存在。

如果你主要的需求是写代码,不要用通用的AI Agent,直接用专门的编程工具——[Cursor](https://www.aitoolbox.hk/tools/cursor/index.html)、Claude Code或者Cline。通用Agent在代码生成上始终比不上专用工具,这是定位决定的。

价格横向对比

把三款Agent的价格放在一起看:

| 项目 | Manus | OpenClaw | MuleRun |

|---|---|---|---|

| 工具费用 | $0/$19/$199 | 免费 | $0/$19.9 |

| API费用 | 包含 | 自理($5-20/月) | 包含 |

| 邀请码 | 需要 | 不需要 | 不需要 |

| 实际月费(中度使用) | $19-199 | $5-20 | $19.9 |

| 实际月费(重度使用) | $199+ | $20-50 | $19.9 |

性价比排名:OpenClaw > MuleRun > Manus

OpenClaw免费+低成本API,重度使用一个月$50封顶。Manus重度使用直接上$199/月。MuleRun固定$19.9/月最省心。

但性价比不是唯一考虑因素——Manus的深度研究能力目前没有平替,$19/月的基础版对经常做研究的人来说很划算。

我的最终选择

测完这三款产品后,我的实际工作流变成了这样:

- 深度研究/竞品调研 → Manus基础版($19/月,物超所值)

- 日常自动化/定时任务 → MuleRun免费版(够用)

- 需要隐私/不想被绑定 → OpenClaw(本地部署,免费)

- 写代码 → [Cursor](https://www.aitoolbox.hk/tools/cursor/index.html)或Cline(专业工具干专业的事)

四个工具各司其职,没有一个是全能的,但组合起来覆盖了我90%的需求。月费总计$25-40,远低于只用一个$199/月的Manus专业版。

FAQ

Q1:AI Agent真的能替代人工吗? A:不能完全替代,但能替代80%的重复性工作。在测试中,三个Agent在明确指令下的完成率都在70%以上,但输出质量需要人工审核。我的建议是把Agent当"实习生"——它能干活,但你得检查和指导。目前阶段,Agent更适合放大你的效率,而不是独立完成复杂工作。

Q2:OpenClaw部署需要什么技术基础? A:至少需要会跑命令行、理解Docker基本概念、能配环境变量。如果你用过命令行装过Python包,部署OpenClaw问题不大。GitHub上有详细的部署教程,跟着走大约30-60分钟。如果你完全不懂命令行,建议先用MuleRun或Manus。

Q3:Manus的邀请码怎么获取? A:目前 Manus 官网有等候名单登记,需要填写邮箱等待。部分渠道(如社群、活动)会不定期发放邀请码。从测试到撰写这篇文章期间我等了两周才拿到。如果你着急用,可以考虑先从MuleRun或OpenClaw开始,Manus拿到邀请码后再补上研究场景。

Q4:哪个Agent最适合做自媒体内容? A:MuleRun。它的Use Case广场里有不少内容创作模板(小红书文案生成、竞品分析、热点追踪),Super Agent模式可以快速生成内容初稿。Manus在深度调研方面更强,但它的异步执行模式不太适合需要快速出稿的场景。OpenClaw需要自己写技能脚本,门槛太高。

Q5:三款Agent哪个最安全?数据会不会泄露? A:安全性排序:OpenClaw(本地部署,数据完全不出你的电脑)> MuleRun(云端但有加密和沙盒隔离)> Manus(云端,Meta收购后数据政策可能有变)。如果你处理敏感数据(客户信息、财务数据、商业机密),OpenClaw是唯一安全的选择。如果是公开信息的调研和分析,三个都够用。

总结

2026年3月的AI Agent市场已经从"概念验证"进入"实战阶段"。三个产品的定位差异比我想象的大得多:

- Manus是研究员:深度研究无敌,但服务不稳定,不支持持续运行。$19/月的基础版值这个价。

- OpenClaw是基建:功能最全面、成本最低、隐私最好,但上手门槛高。适合有技术背景的人,不适合非技术用户。

- MuleRun是助理:零门槛上手,自动化运维最强,但模板质量参差不齐。最适合不想折腾的普通用户。

不要试图只用一个Agent做所有事。 我的实际经验是组合使用效果最好——用Manus做深度研究,用MuleRun做定时自动化,用OpenClaw跑本地敏感任务,用[Cursor](https://www.aitoolbox.hk/tools/cursor/index.html)写代码。每个工具用在它最擅长的场景,才是AI Agent的正确打开方式。

持续关注[AI工具宝箱](https://www.aitoolbox.hk/)获取最新AI工具实测和深度对比,每月更新。