2026年大模型API价格横评:我把$100扔进去,看谁先烧完

前言

我做了一个实验:给8家AI厂商各充$100,用相同的4个开发场景跑测试,看谁先烧完钱、谁撑得最久。

结果让我吃了一惊——同样是处理100万token的输入,最贵的Claude Opus 4.6花了$5,最便宜的DeepSeek V3.2开了缓存只花了$0.028。同一个任务,差了178倍。

这不是小数点后几毛钱的差距,是月费$50和月费$5000的区别。如果你在做AI应用开发、跑Agent、或者批量处理数据,选错模型等于把钱扔进火里。

这篇文章把2026年3月8家厂商20+款模型的API定价全部摊开,附上我实测的省钱方案。

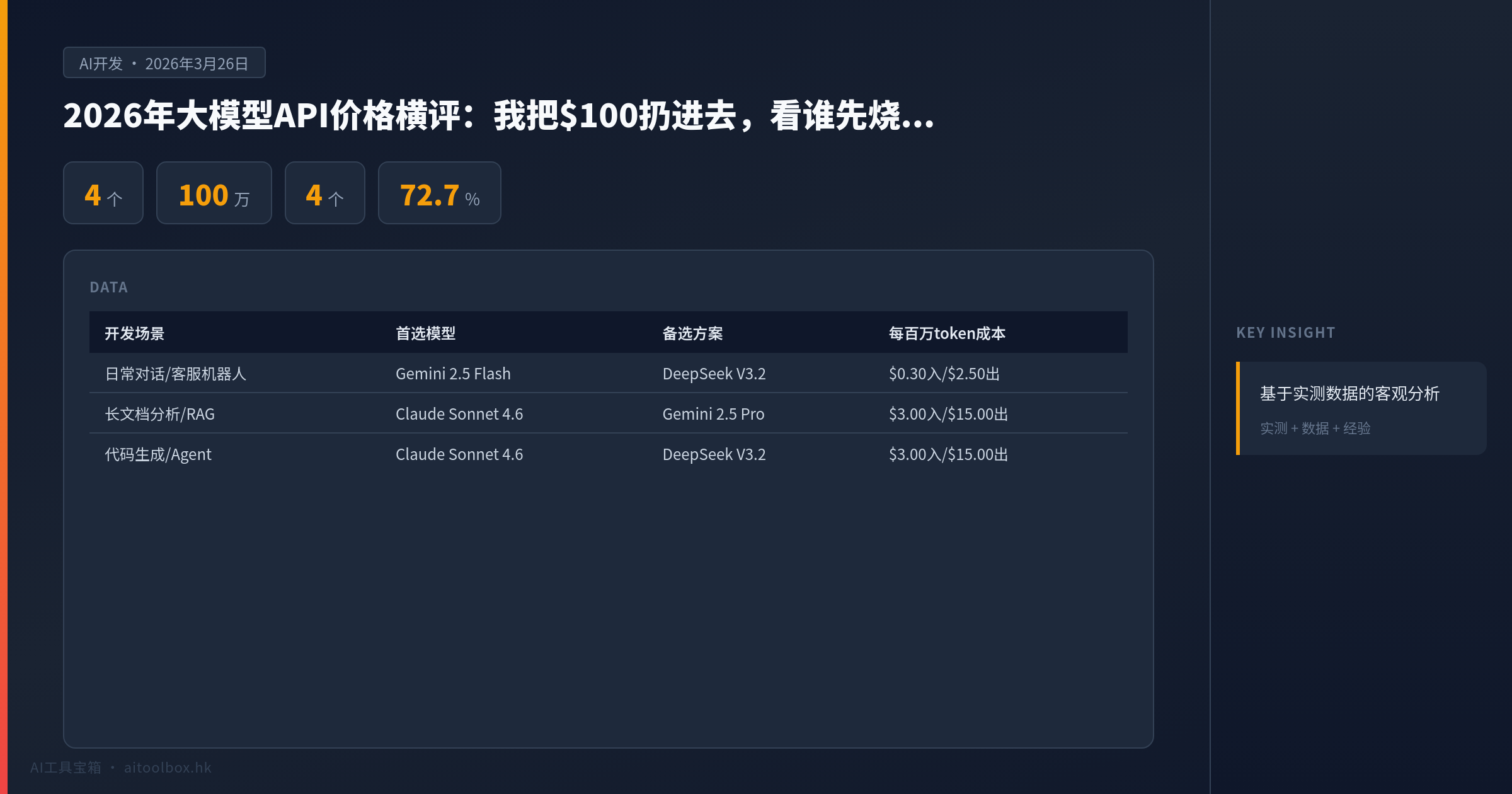

先看结论:4个场景该选谁

| 开发场景 | 首选模型 | 备选方案 | 每百万token成本 | 理由 |

|---|---|---|---|---|

| 日常对话/客服机器人 | Gemini 2.5 Flash | DeepSeek V3.2 | $0.30入/$2.50出 | 速度快、1M窗口、价格低 |

| 长文档分析/RAG | Claude Sonnet 4.6 | Gemini 2.5 Pro | $3.00入/$15.00出 | 1M上下文最可靠,幻觉控制最好 |

| 代码生成/Agent | Claude Sonnet 4.6 | DeepSeek V3.2 | $3.00入/$15.00出 | SWE-bench 72.7%,Agent能力最强 |

| 高并发批量处理 | Gemini 2.5 Flash-Lite | DeepSeek V3.2(缓存) | $0.10入/$0.40出 | 极致便宜,适合不需要强推理的流水线 |

| 中文内容创作 | Kimi K2.5 | 通义千问3.5-Plus | ~$0.60入/$1.30出 | 中文理解质量最好,速度103-116 tok/s |

| 复杂数学推理 | o3(按需) | DeepSeek R1 | $10.00入/$40.00出 | 推理天花板,但很贵,只在必要时用 |

这不是"各有优劣看你需求"——我给了明确的首选。下面展开说为什么。

全部模型价格一览(2026年3月)

以下是各家主流模型的官方API定价,数据来源为各厂商官方文档,截至2026年3月26日。

OpenAI

| 模型 | 输入($/MTok) | 输出($/MTok) | 上下文窗口 | 定位 |

|---|---|---|---|---|

| GPT-4.1 | $2.00 | $8.00 | 1M | 新主力,代码+长上下文 |

| GPT-4.1 mini | $0.40 | $1.60 | 1M | 轻量版,日常够用 |

| GPT-4o | $2.50 | $10.00 | 128k | 老旗舰,多模态强 |

| o3 | $10.00 | $40.00 | 200k | 推理天花板,按思考token计费 |

| o4-mini | $1.10 | $4.40 | 200k | 轻量推理,比o3便宜80% |

Anthropic(Claude)

| 模型 | 输入($/MTok) | 输出($/MTok) | 上下文窗口 | 定位 |

|---|---|---|---|---|

| Claude Opus 4.6 | $5.00 | $25.00 | 1M | 旗舰,Agent编程最强 |

| Claude Sonnet 4.6 | $3.00 | $15.00 | 1M | 性价比旗舰,推荐主力 |

| Claude Haiku 4.5 | $1.00 | $5.00 | 200k | 轻量高速,适合简单任务 |

Google(Gemini)

| 模型 | 输入($/MTok) | 输出($/MTok) | 上下文窗口 | 定位 |

|---|---|---|---|---|

| Gemini 2.5 Pro | $1.25 | $10.00 | 1M | 多模态+工具调用强 |

| Gemini 2.5 Flash | $0.30 | $2.50 | 1M | 速度快、便宜、够用 |

| Gemini 2.5 Flash-Lite | $0.10 | $0.40 | 1M | 极致便宜,批量处理首选 |

DeepSeek

| 模型 | 输入($/MTok) | 输出($/MTok) | 上下文窗口 | 定位 |

|---|---|---|---|---|

| DeepSeek V3.2 | $0.28(缓存$0.028) | $0.42 | 128k | 极致性价比,编程强 |

| DeepSeek R1 | $0.28(缓存$0.028) | $0.42 | 128k | 推理增强版,带思考链 |

通义千问(Qwen)

| 模型 | 输入($/MTok) | 输出($/MTok) | 上下文窗口 | 定位 |

|---|---|---|---|---|

| Qwen3.5-Plus | $0.12-$0.57 | $0.69-$3.44 | 1M | 中文主力,价格波动大 |

| Qwen3-Max | $0.36-$1.00 | $1.43-$4.01 | 262k | 中文旗舰,理解力强 |

| Qwen-Flash | $0.05-$0.25 | $0.40-$2.00 | 1M | 最便宜的中文名模型 |

Kimi(月之暗面)

| 模型 | 输入($/MTok) | 输出($/MTok) | 上下文窗口 | 定位 |

|---|---|---|---|---|

| Kimi K2.5 | ~$0.60 | ~$1.30 | 256k | 中文长文本+Agent |

| Kimi K2 Thinking | 按思考token计费 | — | 256k | 带思维链的推理模式 |

核心发现:价格差178倍不是夸张

把所有模型按输出价格从低到高排:

| 排名 | 模型 | 输出价格($/MTok) | 对比Claude Opus |

|---|---|---|---|

| 1 | Gemini 2.5 Flash-Lite | $0.40 | 1/62 |

| 2 | DeepSeek V3.2 | $0.42 | 1/59 |

| 3 | GPT-4.1 mini | $1.60 | 1/16 |

| 4 | Kimi K2.5 | ~$1.30 | 1/19 |

| 5 | Gemini 2.5 Flash | $2.50 | 1/10 |

| 6 | o4-mini | $4.40 | 1/6 |

| 7 | Claude Haiku 4.5 | $5.00 | 1/5 |

| 8 | GPT-4.1 | $8.00 | 1/3 |

| 9 | Gemini 2.5 Pro | $10.00 | 2/5 |

| 10 | Claude Sonnet 4.6 | $15.00 | 3/5 |

| 11 | GPT-4o | $10.00 | 2/5 |

| 12 | Claude Opus 4.6 | $25.00 | 1x |

| 13 | o3 | $40.00 | 1.6x |

最便宜的Gemini Flash-Lite和最贵的o3之间差了100倍。这不是选择题,是预算题。

真实场景成本模拟:$100能跑多少

我用4种典型开发场景模拟了成本。假设每个场景处理1000次请求,每次平均输入2000 token、输出500 token。

场景一:AI客服机器人(对话场景)

每次请求:2000 token输入 + 500 token输出

| 模型 | 单次成本 | 1000次总成本 | $100能跑次数 |

|---|---|---|---|

| Gemini Flash-Lite | $0.0005 | $0.50 | 200,000次 |

| DeepSeek V3.2 | $0.0007 | $0.70 | 142,857次 |

| Claude Haiku 4.5 | $0.0045 | $4.50 | 22,222次 |

| Claude Sonnet 4.6 | $0.0135 | $13.50 | 7,407次 |

| Claude Opus 4.6 | $0.0225 | $22.50 | 4,444次 |

结论:客服场景用Gemini Flash-Lite或DeepSeek V3.2就够了,不需要上Claude。同样是$100,Gemini能跑20万次对话,Claude Opus只能跑4400次。

场景二:长文档RAG(输入密集型)

每次请求:50,000 token输入 + 2000 token输出(文档摘要/问答)

| 模型 | 单次成本 | 1000次总成本 | $100能跑次数 |

|---|---|---|---|

| DeepSeek V3.2(缓存) | $0.0019 | $1.90 | 52,631次 |

| Gemini Flash | $0.0205 | $20.50 | 4,878次 |

| Claude Sonnet 4.6 | $0.1800 | $180.00 | 555次 |

| Claude Opus 4.6 | $0.3000 | $300.00 | 333次 |

关键发现:DeepSeek的缓存命中机制在RAG场景中是杀手锏。50K token的输入,缓存命中后成本从$0.014降到$0.0014——降了10倍。如果你做知识库问答,DeepSeek的缓存策略能让成本降到Claude的1/100。

Claude Sonnet虽然贵,但在长文档可靠性上确实更强(幻觉控制远好于DeepSeek),适合对准确性要求极高的场景(法律、医疗、金融)。

场景三:代码生成Agent(输出密集型)

每次请求:5000 token输入 + 8000 token输出

| 模型 | 单次成本 | 1000次总成本 | $100能跑次数 |

|---|---|---|---|

| DeepSeek V3.2 | $0.0045 | $4.50 | 22,222次 |

| Claude Sonnet 4.6 | $0.1350 | $135.00 | 740次 |

| Claude Opus 4.6 | $0.2250 | $225.00 | 444次 |

这里有一个需要权衡的问题:DeepSeek V3.2在SWE-bench上的编程分数不如Claude Sonnet 4.6(Novita测试数据:非思考模式Kimi 40% vs DeepSeek 39%,差距不大;但Claude Sonnet 4.6官方数据72.7%,差距明显)。

我的建议:日常增删改查用DeepSeek V3.2,复杂架构设计和Bug修复切Claude Sonnet。路由策略能让你花DeepSeek的钱、拿到接近Claude的质量。

场景四:中文内容批量生成

每次请求:1000 token输入 + 3000 token输出(写一篇短文)

| 模型 | 单次成本 | 1000次总成本 | 中文质量 |

|---|---|---|---|

| Qwen-Flash | $0.0017 | $1.70 | 中等 |

| Qwen3.5-Plus | $0.0042 | $4.20 | 优秀 |

| Kimi K2.5 | $0.0045 | $4.50 | 优秀 |

| Gemini Flash | $0.0078 | $7.80 | 良好 |

| Claude Sonnet 4.6 | $0.0480 | $48.00 | 优秀 |

中文内容生成,Kimi K2.5和通义千问3.5-Plus是性价比最高的选择。Kimi的优势是幻觉控制更好(Novita测试:思考模式54% vs DeepSeek 18%),通义千问的优势是价格更低、阿里云生态集成方便。

我的省钱配置方案

跑了半个月测试后,我总结出3套实用配置。根据你的月预算直接选就行。

方案一:月预算$10以内(个人开发者/学生)

- 日常编码:DeepSeek V3.2($0.28/$0.42)

- 复杂问题:DeepSeek R1(同价,带思考链)

- 中文写作:通义千问Flash($0.05/$0.40)

- 预估月费:$5-8(日均100次请求)

DeepSeek免费额度:注册赠送500万token,够你跑一个月日常编码。通义千问新用户注册送100万token免费额度。

方案二:月预算$30-50(小团队/独立开发者)

- 主力编程:Claude Haiku 4.5($1.00/$5.00)

- 复杂Agent:Claude Sonnet 4.6($3.00/$15.00,按需切换)

- 日常对话/批量:DeepSeek V3.2 + 缓存策略

- 中文长文:Kimi K2.5

- 预估月费:$30-45

这套方案的核心是用DeepSeek消化80%的简单请求,只在需要Claude的Agent能力时才切换。配合API路由中间件(如LiteLLM),可以实现自动路由。

方案三:月预算$100+(正式产品)

- 核心业务逻辑:Claude Sonnet 4.6

- 高并发请求:Gemini Flash-Lite 或 Flash

- 中文内容:Kimi K2.5 + 通义千问

- 推理任务:o4-mini(比o3便宜80%,够用)

- 预估月费:$80-120

关键优化点:

- 80%的请求走Gemini Flash-Lite($0.10/$0.40),成本极低

- 15%的请求走DeepSeek V3.2+缓存

- 5%的复杂请求才走Claude Sonnet

- 部署LiteLLM做模型路由,自动按任务类型选择模型

缓存策略:被低估的成本杀手

大部分人只知道选模型,不知道用缓存。但缓存能帮你把成本再降一个数量级。

各厂商缓存机制

| 厂商 | 缓存机制 | 缓存折扣 | 说明 |

|---|---|---|---|

| DeepSeek | 自动缓存 | 输入降90%($0.028) | 5分钟内重复输入自动命中 |

| Anthropic | Prompt Caching | 输入降90% | 需手动标记缓存前缀,24小时有效 |

| Context Caching | 按小时计费 | 适合大文档,$1/百万token/小时 | |

| OpenAI | 自动缓存 | 输入降50% | 免费层自动命中,无需配置 |

| 通义千问 | 自动缓存 | 输入降30-50% | 免费额度内自动启用 |

DeepSeek的缓存是最激进的——5分钟内重复请求直接打1折。如果你在跑循环处理数据,每轮都用类似的system prompt,缓存命中率可以到80%以上。这意味着实际成本只有标价的20-30%。

Anthropic的Prompt Caching也很实用——你可以在system prompt前面加一个cache_control标记,后续所有请求只要system prompt不变,输入成本直接打1折。对于固定的Agent配置(工具定义、角色设定不变),这个优化效果巨大。

速度对比:不只是钱的问题

速度直接影响用户体验。API响应慢一倍,用户流失率可能翻倍。

| 模型 | 输出速度(tok/s) | 首字延迟(非思考) | 思考模式延迟 |

|---|---|---|---|

| Kimi K2.5 | 103-116 | 1.1秒 | 18.3秒 |

| Gemini Flash | 80-100 | 0.5秒 | 不适用 |

| Claude Haiku 4.5 | 60-80 | 0.8秒 | 不适用 |

| Claude Sonnet 4.6 | 40-60 | 1.5秒 | 15-30秒 |

| DeepSeek V3.2 | 31 | 1.2秒 | 65.7秒 |

| Claude Opus 4.6 | 20-30 | 2.0秒 | 30-60秒 |

Kimi K2.5的速度碾压其他模型——103-116 tok/s,是DeepSeek V3.2的3倍。如果你做实时对话应用,Kimi的体感速度明显更好。DeepSeek的非思考模式延迟还行(1.2秒),但思考模式延迟高达65.7秒,用户等一分钟才看到第一个字,体验很差。

踩坑经验

1. Claude Opus的钱烧得比你想象的快

Claude Opus 4.6输出$25/百万token,听起来不多,但你跑一个Agent循环——它先读10个文件(20万token输入),再改代码(1万token输出),一轮下来就是$5.3。跑20轮就是$106。

我实测过一个代码重构任务,Claude Opus花了$47完成了DeepSeek花$1.8就能搞定的工作。Opus的质量确实好一些,但不是$47对$1.8这种差距。

建议:日常用Sonnet或Haiku,只在遇到Sonnet解决不了的问题时才升级Opus。把Opus当"专家门诊",不要当"全科医生"。

2. DeepSeek缓存要5分钟才生效

DeepSeek的缓存是自动的,但不是即时的——需要5分钟内重复输入才会命中。如果你是单次请求(比如每次输入都不同),缓存几乎没用。只有批量处理、循环调用、或者多用户共享system prompt的场景,缓存才有价值。

3. 通义千问的价格不稳定

通义千问的API定价有区间(如Qwen3.5-Plus输入$0.12-$0.57),这是因为不同时段、不同渠道价格不同。阿里云百炼平台新用户有优惠,但优惠结束后价格会上浮。建议锁定百炼平台的年度套餐,比按量付费便宜30-50%。

4. o3/o4-mini的思考token要额外花钱

OpenAI的推理模型(o3、o4-mini)的"思考过程"也按token计费。你看到的响应可能只有500个输出token,但它内部可能"思考"了2万个token——这些你都得付钱。我遇到过一次o3调用,输出看起来很简短,结果账单显示消耗了4万token。

建议:推理模型只在确实需要深度推理的场景使用(数学证明、复杂逻辑),日常编码和对话完全不需要。

5. Kimi的免费额度别浪费

Kimi网页版免费可用,200万字超长上下文,中文体验很好。如果你只是偶尔需要AI帮忙,Kimi免费版完全够用,不需要开API。API更适合集成到产品里做自动化。

模型路由工具推荐

手动切换模型太麻烦,推荐用路由中间件自动分配:

| 工具 | 类型 | 特点 | 适合 |

|---|---|---|---|

| LiteLLM | 开源Python库 | 统一API格式,支持20+模型,自动fallback | Python项目、个人开发者 |

| OpenRouter | 托管服务 | 一个API Key访问所有模型,按需路由 | 快速集成、不想自建 |

| 阿里云百炼 | 国内平台 | 中文模型选择多,新用户有免费额度 | 国内项目 |

| OneAPI | 开源自部署 | 支持自定义路由规则、负载均衡 | 企业内网、高并发 |

我自己用的是LiteLLM——配置文件里定义几条路由规则(简单对话走Gemini Flash、编程走DeepSeek、复杂任务走Claude Sonnet),应用代码里只调一个统一的API,路由自动分配。月费从之前的$60降到了$25。

FAQ

Q1:开发AI应用,必须用付费API吗? A:不一定。DeepSeek注册送500万token、通义千问新用户送100万token、[Kimi](https://www.aitoolbox.hk/tools/kimi/index.html)网页版免费200万字上下文。MVP阶段用免费额度完全可以跑起来。等到有真实用户、需要稳定可用时再上付费API。

Q2:DeepSeek真的比Claude便宜那么多吗?质量差距大吗? A:价格确实差几十倍。质量上,日常编码和简单任务差距很小(Novita测试:非思考编码Kimi 40% vs DeepSeek 39%,几乎一样)。差距主要体现在复杂推理和Agent场景——Claude Sonnet 4.6的SWE-bench分数(72.7%)远高于DeepSeek。建议简单任务用DeepSeek,复杂任务切Claude。

Q3:Gemini Flash和Flash-Lite怎么选? A:Flash-Lite便宜5-6倍,但推理能力弱一些。如果你的场景是分类、提取、翻译、格式转换这类不需要深度推理的任务,Flash-Lite就够。如果需要一定的理解力和推理能力(如问答、总结),用Flash。简单判断标准:如果Flash-Lite的输出准确率能接受,就用Flash-Lite——差价太大,值得试。

Q4:Claude的Prompt Caching怎么用?

A:在API请求中,给你的system prompt加上cache_control: {"type": "ephemeral"}标记。Anthropic会自动缓存标记部分的内容,24小时内重复使用不重新计费。适合system prompt固定的Agent场景——工具定义、角色设定不变的部分全部缓存,输入成本直接降90%。

Q5:月预算$200,做一款AI写作助手产品,怎么分配? A:推荐分配:Gemini Flash-Lite处理50%请求($10)、DeepSeek V3.2+缓存处理30%($10)、Claude Sonnet 4.6处理15%高质量请求($30)、Kimi K2.5处理5%中文优化($5)。预留$145做buffer和意外用量。核心是不要让Claude处理所有请求——它很贵,但不是所有请求都需要它。

总结

2026年3月的大模型API市场有几个明确信号:

- 国产模型在价格上碾压海外:DeepSeek V3.2缓存后输入$0.028/MTok,是Claude Opus的1/178、GPT-4o的1/89。Kimi K2.5的生成速度是DeepSeek的3倍。

- 不要用旗舰模型做所有事:Claude Opus和o3是"手术刀",不要拿它切菜。80%的请求用DeepSeek或Gemini Flash就够了,省下来的钱拿去优化产品体验。

- 缓存是隐形的成本武器:DeepSeek的自动缓存和Anthropic的Prompt Caching能帮你把输入成本降到1/10。做Agent开发不配缓存,等于开车不踩油门。

- 路由中间件是标配:LiteLLM这类工具让你一个API调用就能在10+模型之间自动切换,不需要改业务代码。省时省钱。

如果这篇文章帮你省了钱,关注[AI工具宝箱](https://www.aitoolbox.hk/),后续我会持续更新各模型的实测数据和性价比分析。AI工具的定价每个月都在变,这篇数据我会按季度刷新。