Sora关停、LiteLLM被投毒、Arm造出136核AGI芯片、Claude操控你的电脑:AI圈本周发生了什么

前言

这周AI圈炸了四次。OpenAI亲手砍掉了Sora——那个曾经让全世界为之疯狂的AI视频产品,存活不到半年就下线。就在同一天,LiteLLM被投毒了——9500万月下载量的Python包被植入了窃取凭证的后门,用了Cursor、Claude Code的开发者可能中招。与此同时,Arm做了35年来从没做过的事——自己造了一颗136核的CPU,Meta买了第一张票。而Anthropic直接把鼠标交给了Claude,让它操作你的电脑干活。

四件事放在一起,指向一个清晰的信号:AI行业正在从"能不能做"进入"该不该做、怎么做才赚钱"的阶段。

事件一:Sora之死——OpenAI史上最大规模产品关停

发生了什么

3月24日(美国时间),OpenAI宣布全面关停Sora——独立App、API接口、ChatGPT内置视频功能,全部下线。从2025年9月独立App上线到关停,Sora只活了6个月。这是OpenAI历史上最大规模的产品关停。

Sam Altman在内部会议上说得很直白:"我们不可能同时做所有事情。"

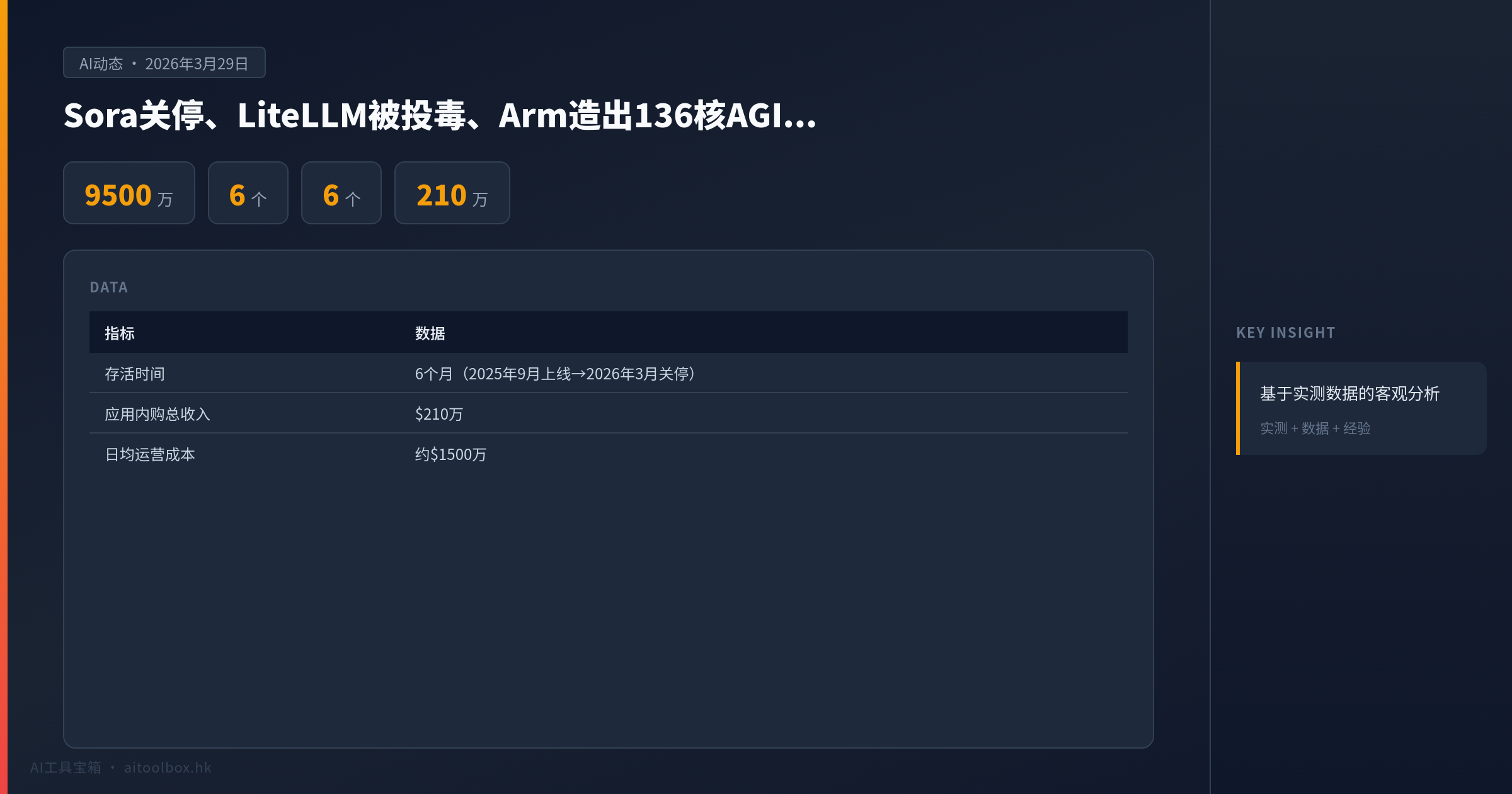

为什么关停——数字说明一切

| 指标 | 数据 |

|---|---|

| 存活时间 | 6个月(2025年9月上线→2026年3月关停) |

| 应用内购总收入 | $210万 |

| 日均运营成本 | 约$1500万 |

| 半年总烧钱估算 | 约$2.7亿 |

| 2025年12月下载量环比 | -32% |

| 2026年1月安装量环比 | -45% |

| 首日峰值(Android上线) | 登顶Google Play榜首,24h生成100万+视频 |

$210万的收入对$2.7亿的成本,这个比例用"入不敷出"来描述都太客气了。更扎心的是,Sora在发布当天确实引爆了下载——Android版上线首日登顶Google Play,24小时内用户生成了超过100万条视频。但峰值之后就是自由落体:12月下载量跌了32%,1月安装量再跌45%。

关停背后的深层原因

不只是Sora不赚钱。OpenAI正面临更严峻的局面:

- 企业市场被Anthropic蚕食:2026年2月新采购AI服务的企业中,选Anthropic的是OpenAI的3倍。Claude Code单月带来$60亿收入,而ChatGPT订阅量反而在下降(-1.5%)

- 产品线过度分散:Altman自己承认,OpenAI像"在内部押注一系列初创公司",精力被摊薄

- IPO压力:OpenAI刚完成$1100亿融资(估值$8400亿),投资方要求快速证明商业化能力

关停Sora不是某个产品的失败,是OpenAI从"什么都做"转向"只做能赚钱的"战略转折点。

Sora死了,AI视频没死

Sora关停不意味着AI视频赛道凉了。相反,这个赛道已经进入"战国时代":

- 字节Seedance 2.0:Elo 1269分超过Sora,集成在剪映里直接用

- Google Veo 3:通过Gemini和Flow平台7周生成4000万+视频,平台化优势明显

- MiniMax Hailuo:海螺视频用户超2亿,已证明商业模式可行

Sora退出后,AI视频赛道的重心从"谁能生成最好看的视频"转向"谁能把视频生成嵌入实际工作流"。字节把Seedance塞进剪映、Google把Veo整合进Gemini——平台化嵌入才是AI视频的正确出路。独立App的模式已经走不通了。

对用户的影响

- 已生成的Sora视频作品需要在关停前下载保存

- API接口停止服务后,依赖Sora API的应用需要迁移到其他视频生成服务

- 建议转向剪映(Seedance)、Runway、Pika等替代方案

事件二:LiteLLM被投毒——9500万月下载量的包差点成了后门

发生了什么

3月24日,安全研究者发现LiteLLM的两个恶意版本(1.82.7和1.82.8)被发布到PyPI。这个包月下载量超过9500万次,被Stripe、Netflix、Google ADK等大公司使用。攻击者TeamPCP通过入侵LiteLLM的CI/CD流水线,窃取了PyPI发布令牌,直接发布了带后门的版本。

暴露窗口约3小时(3月24日10:39-13:30 UTC),之后PyPI隔离了整个litellm项目。

攻击链怎么运作的

这个攻击设计得相当精巧,分三步走:

第一步:入侵Trivy(3月19日)

TeamPCP利用GitHub Actions的pull_request_target漏洞,入侵了Aqua Security的Trivy安全扫描器。Trivy是很多开源项目CI/CD里用的安全扫描工具——讽刺的是,安全工具本身被黑了。

第二步:窃取PyPI发布令牌(3月24日)

恶意Trivy Action在LiteLLM的CI/CD流水线中执行,截获了PyPI发布令牌。攻击者用这个令牌直接向PyPI发布恶意版本,完全绕过了GitHub源码审查——因为恶意代码根本不在GitHub的代码里,是发布时才注入的。

第三步:植入后门(1.82.7和1.82.8)

| 版本 | 注入方式 | 触发条件 |

|---|---|---|

| 1.82.7 | 嵌入proxy_server.py | import litellm时触发 |

| 1.82.8 | 新增litellm_init.pth | 任何Python进程启动时自动执行 |

1.82.8尤其阴毒——利用Python的site.py机制,不需要你import任何东西,只要你的环境里装了这个版本,启动Python就会执行恶意代码。

后门干了什么

分三个阶段,一个比一个狠:

阶段一:凭证窃取 扫描50+类敏感数据,包括SSH密钥、AWS/GCP/Azure云凭据、Kubernetes Secret、数据库密码、CI/CD令牌、加密货币钱包。如果检测到AWS环境,还通过SigV4签名直接查询Secrets Manager和SSM Parameter Store——不是猜密码,是直接用IMDSv2获取临时合法凭证。

阶段二:加密外泄

用AES-256-CBC加密数据,RSA-4096包装会话密钥,通过HTTPS POST发送到C2域名models.litellm[.]cloud——伪装成LiteLLM官方的模型API域名,很难从流量里区分。

阶段三:Kubernetes横向移动 如果在K8s环境,会在所有节点部署特权Pod,挂载宿主机根文件系统,安装systemd持久化后门。每50分钟向另一个C2拉取新负载。

谁受影响

任何在3月24日10:39-13:30 UTC期间安装或更新了LiteLLM的环境。

LiteLLM是AI应用开发中最常用的模型路由库之一——Cursor和Claude Code的很多配置教程都推荐用LiteLLM做多模型路由。如果你用AI编程工具的过程中配过LiteLLM,赶紧检查版本。

怎么排查和修复

# 1. 检查版本

pip show litellm | grep Version

# 如果显示1.82.7或1.82.8,立刻处理

# 2. 查找恶意的.pth文件

find "$(python3 -c 'import site; print(site.getsitepackages()[0])')" -name "litellm_init.pth"

# 3. 检查持久化后门

ls -la ~/.config/sysmon/sysmon.py

# 4. K8s环境检查

kubectl get pods -n kube-system | grep node-setup

修复步骤:卸载LiteLLM → 删除.pth文件 → 清理后门组件 → 轮转所有凭据(SSH密钥、API Key、数据库密码全部换一遍)。

这件事的教训

LiteLLM事件暴露了AI开发生态的一个系统性问题——我们对底层依赖的信任没有边界。LiteLLM连接着你的各种LLM API Key(OpenAI、Anthropic、Google),一旦被投毒,这些Key全部暴露。而9500万的月下载量意味着这个攻击面极大。

对个人开发者来说,最实际的教训是:不要盲目pip install -U。特别是在CI/CD流水线里,固定依赖版本比追最新版重要得多。

事件三:Arm造出了自己的芯片——136核,Meta买单

发生了什么

3月24日,Arm发布了Arm AGI CPU——这是这家公司35年历史上的第一款自研芯片。之前35年,Arm只做芯片设计授权,不做芯片本身。这次直接造了一颗136核的数据中心CPU,Meta是第一个公开客户。

为什么重要

Arm是全球芯片架构的霸主——全球99%的智能手机用的都是Arm架构。但Arm自己不做芯片,只卖IP授权(就像英伟达自己造显卡但不卖设计给别人一样)。Arm自己下场造芯片,相当于英伟达突然宣布要自己设计x86处理器——整个行业的格局都要抖三抖。

规格数据

| 指标 | 数据 |

|---|---|

| 核心数 | 136核(基于Neoverse V3) |

| 单机架性能 | 最新x86系统的2倍以上 |

| 风冷机架功耗 | 36kW(30台刀片,8160核/机架) |

| 液冷方案 | 200kW(超45000核/机架) |

| 首发客户 | Meta(吉瓦级基础设施部署) |

| 合作伙伴 | 50+家(Cerebras、Cloudflare、OpenAI、SK电讯等) |

| 上市状态 | 已开放订购 |

为什么Meta选Arm不选x86

Meta的AI基础设施需要处理海量的AI推理调度任务。传统的x86服务器(Intel/AMD)在AI推理场景下的能效比不够好——推理任务对内存带宽和并发线程的需求远超单线程性能。Arm AGI CPU 136核的设计正好契合这个需求:更多核心、更高内存带宽、更低的每瓦成本。

Meta计划将AGI CPU与自研MTIA加速器协同工作——AGI CPU负责推理调度和任务编排,MTIA负责密集计算。分工明确,效率更高。

对行业的影响

- Intel/AMD压力大:数据中心CPU市场本来是他们俩的地盘,现在Arm亲自下场,还有Meta站台

- AI推理成本有望下降:2倍性能意味着同样算力支出能跑更多推理任务

- AI编程工具用户间接受益:推理成本下降→API价格下降→用ChatGPT、Claude等工具的成本也会跟着降

事件四:Claude能操作你的电脑了

发生了什么

3月23日,Anthropic推出Claude Computer Use功能——Claude现在可以直接打开你的应用、操作浏览器、运行开发工具来完成任务。同时推出的还有Dispatch功能,让你从手机给电脑上的Claude派任务。

目前只支持macOS,作为研究预览版发布。

能干什么

Claude Computer Use不是模拟点击,是真的像人一样操作你的电脑:

- 打开Chrome浏览器,搜索信息

- 打开VS Code,编辑代码文件

- 打开终端,运行命令

- 打开邮件客户端,回复邮件

- 打开Excel,处理数据

配合Dispatch功能,你可以从手机上给Claude派任务——"帮我把那个PDF转成PPT,做好后发到我邮箱"——Claude会在你的Mac上完成这个任务。

安全性

Anthropic在Claude Code Auto Mode上已经证明了他们重视安全(用分类器自动判断操作安全性)。Computer Use也采用了类似思路,但目前仍标注为"研究预览",说明Anthropic自己也在摸索边界。

对AI编程工具的影响

Computer Use让Claude从"编码助手"进化成"通用电脑操作员"。这意味着它不仅能帮你写代码,还能帮你部署代码(打开终端跑git push)、检查线上状态(打开浏览器看监控面板)、处理非编码任务(回邮件、整理文件)。

对Cursor和Claude Code这样的专用编程工具来说,Computer Use既是补充也是竞争——当Claude能操作整个电脑时,还需要一个专门的编辑器插件吗?

四件事串在一起看

| 事件 | 信号 |

|---|---|

| Sora关停 | AI行业从"卷功能"转向"卷商业化",做不做得出功能不是问题,能不能赚钱才是 |

| LiteLLM被投毒 | AI开发生态的安全隐患正在被武器化,基础设施的信任边界需要重新定义 |

| Arm AGI CPU | AI推理的硬件基础在加速变革,x86时代可能走向终结 |

| Claude Computer Use | AI工具从"被动响应"走向"主动操作",人机交互范式在变 |

四个信号指向同一个趋势:AI正在从"玩具"变成"基础设施",而这个过程中,安全、成本和商业化是三个绕不过去的坎。

Sora告诉我们,就算你做了全世界最酷的东西,不赚钱也得死。LiteLLM告诉我们,你的AI工具链里任何一环被攻破,后果不堪设想。Arm AGI CPU告诉我们,支撑AI的基础设施正在发生结构性变化。Claude Computer Use告诉我们,AI和人类的协作方式正在被重新定义。

对普通AI用户和开发者的建议:

- 检查你的LiteLLM版本——如果你在用AI编程工具时配过LiteLLM,立刻排查

- 别把鸡蛋放一个篮子里——Sora关停提醒我们,不要依赖单一供应商的服务

- 关注推理成本变化——Arm AGI CPU和TurboQuant等技术正在快速降低AI推理成本

- 警惕供应链安全——

pip install -U之前想一想,你真的需要最新版吗?

本周其他值得关注的消息

- OpenAI整合产品线:将ChatGPT、Codex、浏览器Atlas合并为统一的桌面超级应用

- Claude Opus 4.6发布:Anthropic同日发布,Tom's Guide评为"实际工作任务"的最佳AI

- Anthropic完成$35亿E轮融资:投后估值$615亿

- Anysphere(Cursor母公司)D轮融资$23亿:AI编程赛道持续吸金

- 中关村论坛AI主题日:众智FlagOS 2.0发布,全球首个通用智能体安全标准启动

FAQ

Q1:Sora关停后,我的视频怎么办? A:OpenAI提供了作品保全时间窗口,请在关停前下载所有已生成的视频。替代方案推荐:剪映(集成Seedance 2.0,国内直接用)、Runway Gen-4(专业级视频生成)、Pika 2.0(操作简单,适合短视频)。

Q2:我装了LiteLLM,怎么确认有没有中招?

A:运行pip show litellm查看版本。如果是1.82.7或1.82.8,说明可能受影响。即使安装了其他版本,也建议执行排查命令(本文第二部分有详细步骤),特别是检查litellm_init.pth文件和~/.config/sysmon/目录是否存在。

Q3:Claude Computer Use和之前微软的Windows Copilot有什么区别? A:区别很大。Windows Copilot主要是对话式助手,回答问题、提供建议,但不直接操作。Claude Computer Use是真的接管鼠标和键盘,像人一样打开应用、点击按钮、输入文字。它能自主完成一系列操作,而不是告诉你"你应该怎么做"。

Q4:Arm AGI CPU什么时候能买到? A:已开放订购,永擎电子、联想、Supermicro提供商用系统。但对个人开发者来说,更实际的影响是:如果你用的是AWS或Azure的云服务器,未来可能会用到基于Arm AGI CPU的实例,推理性能更强、成本更低。

Q5:OpenAI关停Sora,是不是说明AI视频不行了? A:恰恰相反。AI视频赛道热度不减,只是商业模式在进化。Sora的失败在于它选择了"独立App"这条路——单独做一个视频生成App,用户付费意愿低、运营成本高。而字节把Seedance集成在剪映里、Google把Veo整合在Gemini中,走的是"平台嵌入"路线,用户在使用现有工具的过程中顺便用AI生成视频,付费意愿高得多。AI视频不是不行了,是模式选错了。

总结

2026年3月最后一周的AI圈,可以用四个关键词概括:关停、被黑、造芯、接管。

Sora从封神到退场只用了25个月,给所有AI创业公司上了一课:技术领先不等于商业成功。LiteLLM的9500万月下载量被投毒,暴露了AI生态最脆弱的一环——我们对基础设施的信任需要重新审视。Arm自研136核CPU,Meta直接买单,数据中心芯片的格局正在被改写。Claude接管你的电脑操作,AI工具的自主性再次向前迈了一大步。

这四件事放在一起看,2026年的AI行业已经过了"看demo激动"的阶段,进入了真刀真枪拼商业化的时期。技术还在进步,但决定胜负的不再只是技术,而是安全、成本和落地能力。

关注AI工具宝箱获取最新AI工具评测和行业动态,每周更新。